声明:本文来自于微信公众号 机器之心(ID:almosthuman2014),作者:xxxxx,授权站长之家转载发布。

你说箱子里要装满钻石,于是箱子被钻石填满,比实拍还要耀眼。这样的技能,哪个剧组不喜欢?

这是前段时间 Adobe 旗下的视频剪辑软件 Premiere Pro 所呈现的「魔法」。该软件通过引入 Sora、Runway、Pika 等 AI 视频工具,实现在视频中添加物体、消除物体以及生成视频片段等能力,这被视为视频领域的再一次技术革新。

从2月份 Sora 席卷全球到如今 Adobe 再施魔法,海外热火朝天。相比之下,国内在视频领域,尤其是长视频生成方向还处于「等待」状态。在过去的两个月里,我们已经听到了一些宣称追赶 Sora 的声音,但是目前还没有看到国内取得明显进展。但今天生数科技 刚刚发布的这支短片,让我们看到了不少惊喜。

这是生数科技联合清华大学最新 发布的视频大模型「Vidu 」 所官宣的视频。可以看出,它生成的视频不再是持续几秒的「GIF」,而是达到了十几秒(最长可以达到16秒左右)。当然更令人惊喜的是,「Vidu」画面效果非常接近 Sora,在多镜头语言、时间和空间一致性、遵循物理规律 等方面表现都非常出色,而且还能虚构出真实世界不存在的超现实主义画面 ,这是当前的视频生成模型难以实现的。在短短两个月的时间,生数科技能实现到这般效果,着实令人惊喜。

国内首个 全面对标 Sora 的视频模型

自 Sora 发布之后,「国产 Sora」的争夺战就打响了。但当行业都聚焦于「长」这一特性时,却都忽略了 Sora 的背后其实是综合效果的提升,例如长时序下的一致性、真实度、美观性等等。

从综合效果看,「Vidu」是首个 也是唯一 在效果层面全面对标 Sora 的视频模型 ,不仅仅在国内,在全球范围,也是继 Sora 之后首个 完成突破的视频模型。从具体效果,可以显著看到几处明显的优势:

给视频注入「镜头语言」

在视频制作 中有个非常重要的概念 —— 镜头语言。它是通过画面来表达故事情节、揭示角色心理、营造氛围以及引导观众情感的主要方式。不同的镜头选择、角度、运动和组合将极大地影响叙事的效果和观众的感受。

现有 AI 生成的视频,能够明显地感觉到镜头语言的单调,镜头的运动局限于轻微幅度的推、拉、移等简单镜头。其背后的主要原因是,现有的视频内容生成大多是先通过生成单帧画面,再做连续的前后帧预测,但主流的技术路径,很难做到长时序的连贯预测,只能做到小幅的动态预测。

Runway 在去年7月份生成的科幻电影预告片《Trailer: Genesis》(《创世纪》)。

「Vidu」则突破了这些局限。在一个「海边小屋」为主题的片段中,我们可以看到,「Vidu」一次生成的一段片段中涉及多个镜头,画面既有小屋的近景特写,也有望向海面的远眺,整体看下来有种从屋内到走廊再到栏杆边赏景的叙事感。可以看出,「Vidu」能够围绕统一主体在一段画面里实现远景、近景、中景、特写等不同镜头的切换。

提示:在一个古色古香的海边小屋里,阳光沐浴着房间,镜头缓慢过渡到一个阳台,俯瞰着宁静的大海,最后镜头定格在漂浮着大海、帆船和倒影般的云彩。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

此外,从短片中的多个片段能看到,「Vidu」能直接生成转场、追焦、长镜头等效果,包括能够生成影视级的镜头画面,给视频注入镜头语言,提升画面的整体叙事感。

保持时间和空间的一致性

视频画面的连贯和流畅性至关重要,这背后其实是人物和场景的时空一致性,比如人物在空间中的运动始终保持一致,场景也不能在没有任何转场的情况下突变。而这一点 AI 很难实现,尤其时长一长,AI 生成的视频将出现叙事断裂、视觉不连贯、逻辑错误等问题, 这些问题会严重影响视频的真实感和观赏性。

「Vidu」在一定程度上克服了这些问题。从它生成的一段「带珍珠耳环的猫」的视频中可以看到,随着镜头的移动,作为画面主体的猫在3D 空间下一直保持着表情、服饰的一致,视频整体上非常连贯、流畅,保持了很好的时间、空间一致性。

提示:这是一只蓝眼睛的橙色猫的肖像,慢慢地旋转,灵感来自维米尔的《戴珍珠耳环的少女》,画面上戴着珍珠耳环,棕色头发像荷兰帽一样,黑色背景,工作室灯光。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

模拟真实物理世界

Sora 令人惊艳的一大特点,就是能够模拟真实物理世界的运动,例如物体的移动和相互作用。其中 Sora 发布过的一个经典案例 ——「一辆老式 SUV 行驶在山坡上」的画面,非常好地模拟了轮胎扬起的灰尘、树林中的光影以及车行驶过程中的阴影变化。在同样的提示词下,「Vidu」与 Sora 生成效果高度接近,灰尘、光影等细节与人类在真实物理世界中的体验非常接近。

提示:镜头跟随一辆带有黑色车顶行李架的白色老式 SUV,它在陡峭的山坡上一条被松树环绕的陡峭土路上加速行驶,轮胎扬起灰尘,阳光照射在 SUV 上,给整个场景投射出温暖的光芒。土路缓缓地蜿蜒延伸至远方,看不到其他汽车或车辆。道路两旁都是红杉树,零星散落着一片片绿意。从后面看,这辆车轻松地沿着曲线行驶,看起来就像是在崎岖的地形上行驶。土路周围是陡峭的丘陵和山脉,上面是清澈的蓝天和缕缕云彩。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

Sora的生成效果。

当然在「带有黑色车顶行李架」的局部细节上,「Vidu」没能生成出来。但瑕不掩瑜,它的整体效果已高度接近真实世界。

丰富的想象力

与实景拍摄相比,用 AI 生成视频有一个很大的优势 —— 它可以生成现实世界中不存在的画面。以往,这些画面往往要花费很大的人力、物力去搭建或做成特效 ,但是 AI 短时间就可以自动生成了。

比如在下面这个场景中,「帆船」、「海浪」罕见地出现在了画室里,而且海浪与帆船的交互动态非常自然。

提示:画室里的一艘船驶向镜头。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

短片中的「鱼缸女孩」的片段也是奇幻但又具有一定的合理感。这种能够虚构真实世界不存在的画面的能力,对于创作超现实主义内容非常有帮助,不仅可以激发创作者的灵感,提供新颖的视觉体验,还能拓宽艺术表达的边界,带来更加丰富和多元化的内容形式。

理解中国元素

除了以上四方面的特点外,我们从「Vidu」放出的短片中还看到了一些不一样的惊喜,「Vidu」能够生成特有中国元素的画面,比如熊猫、龙、宫殿场景等。

提示:在宁静的湖边,一只熊猫热切地弹着吉他,让整个环境变得活跃起来。晴朗天空下平静的水面倒映着这一场景,以生动的全景镜头捕捉到,将现实主义与大熊猫活泼的精神融为一体,创造出活力与平静的和谐融合。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

两个月快速突破,背后是怎么做到的?

「Vidu」背后的研发团队生数科技是国内多模态大模型方向的创业团队,核心成员来自清华大学人工智能研究院,团队专注于图像、3D、视频等多模态生成领域。

在今年1月份,生数科技在旗下视觉创意设计平台 PixWeaver 就上线了短视频 生成功能,支持4秒高美学性的短视频 内容。2月份 Sora 推出后,据悉,生数科技内部成立了正式的攻坚小组,加快了原本视频方向的研发进度,3月份内部就实现了8秒的视频生成,紧接着4月份就突破了16秒生成,生成质量与时长全方面取得突破。

众所周知,Sora 并没有公布太多的技术细节,能在这么短的时间内取得突破,背后核心是团队深厚的技术积累和诸多从0到1的原创成果,尤其是在最核心的技术架构层面。

「Vidu」底层基于完全自研的 U-ViT 架构 ,该架构由团队在2022年9月提出,早于 Sora 采用的 DiT 架构,是全球首个 Diffusion 和 Transformer 融合的架构 。

在 DiT 论文发布两个月前,清华大学的朱军团队提交了一篇论文 ——《All are Worth Words: A ViT Backbone for Diffusion Models》。这篇论文提出了用 Transformer 替代基于 CNN 的 U-Net 的网络架构 U-ViT。这是「Vidu」最重要的技术基础。

在技术路线上,「Vidu」采用了和 Sora 完全一致的 Diffusion 和 Transformer 融合的架构。不同于采用插帧的多步骤处理方式来达到长视频的生成,「Vidu」采用的是和 Sora 一致的路线,即通过单一步骤直接生成高质量的视频。从底层来看,这是一种「一步到位」的实现方法,基于单一模型完全端到端生成,不涉及中间的插帧和其他多步骤的处理,文本到视频的转换是直接且连续的。

另外基于 U-ViT 架构,2023年3月,团队在开源的大规模图文数据集 LAION-5B 上训练了10亿参数量的多模态模型 ——UniDiffuser,并将其开源(参见《清华朱军团队开源首个 基于 Transformer 的多模态扩散大模型,文图互生、改写全拿下》)。

UniDiffuser 主要擅长图文任务,能支持图文模态间的任意生成和转换。UniDiffuser 的实现有一项重要的价值 —— 首次 验证了融合架构在大规模训练任务中的可扩展性(Scaling Law),相当于将 U-ViT 架构在大规模训练任务中的所有环节流程都跑通。值得一提的,UniDiffuser 比同样 DiT 架构的图文模型 Stable Diffusion3的提出领先了一年。

这些在图文任务中积累的工程经验为视频模型的研发打下了基础。因为视频本质上是图像的流,相当于是图像在时间轴上做了一个扩增。因此,在图文任务上取得的成果往往能够在视频任务中得到复用。Sora 就是这么做的:它采用了 DALL・E3的重标注技术,通过为视觉训练数据生成详细的描述,使模型能够更加准确地遵循用户的文本指令生成视频。这种效应也必然会发生在「Vidu」上面。

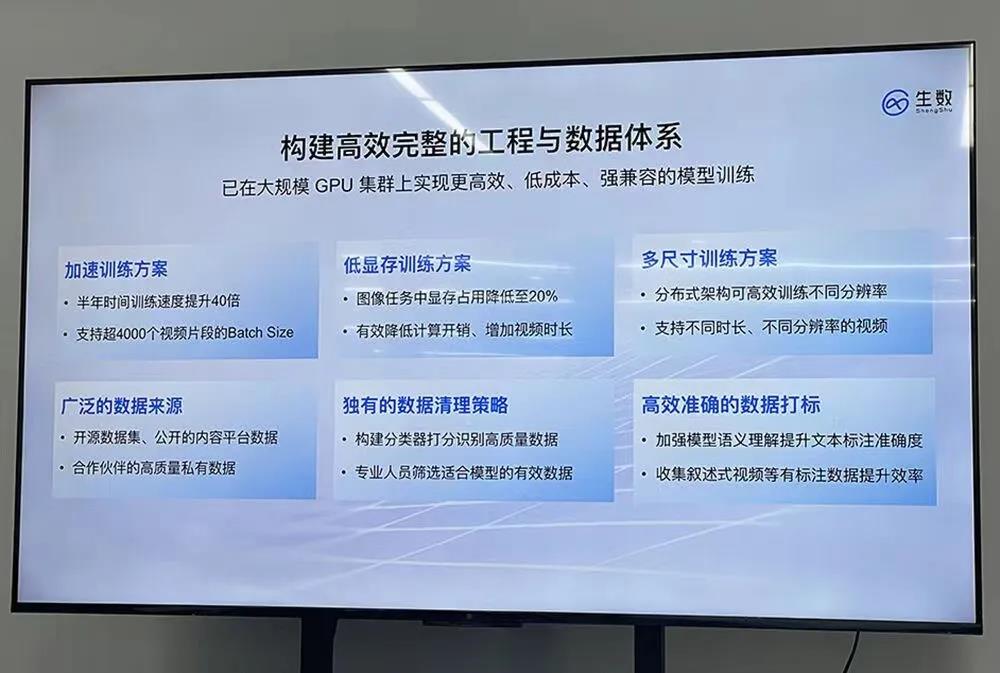

根据此前生数科技组织的一场小规模沟通会上的消息推测,「Vidu」也复用了生数科技在图文任务的很多经验,包括训练加速、并行化训练、低显存训练等等,从而快速跑通了训练流程。据悉,他们通过视频数据压缩技术降低输入数据的序列维度,同时采用自研的分布式训练框架,在保证计算精度的同时,通信效率提升1倍,显存开销降低80%,训练速度累计提升40倍。

从图任务的统一到融合视频能力,「Vidu」可被视为一款通用视觉模型,能够支持生成更加多样化、更长时长的视频内容。官方也透露,「Vidu」目前还在加速迭代提升。面向未来,「Vidu」灵活的模型架构也将能够兼容更广泛的多模态能力。

来自清华系的精干团队

最后,再聊下「Vidu」背后的团队 —— 生数科技,这是一支清华背景的精干团队。

生数科技的核心团队来自清华大学人工智能研究院。首席科学家由清华人工智能研究院副院长朱军 担任;CEO唐家渝 本硕就读于清华大学计算机系,是 THUNLP 组成员;CTO鲍凡 则是清华大学计算机系博士生、朱军教授的课题组成员,长期关注扩散模型领域研究,U-ViT 和 UniDiffuser 两项工作均是由他主导完成的。

团队从事生成式人工智能和贝叶斯机器学习的研究已有20余年,在深度生成模型突破的早期就开展了深入研究。在扩散模型方面,团队于国内率先开启了该方向的研究,成果涉及骨干网络、高速推理算法、大规模训练等全栈技术方向。

团队于 ICML、NeurIPS、ICLR 等人工智能顶会发表多模态领域相关论文近30篇,其中提出的免训练推理算法 Analytic-DPM、DPM-Solver 等突破性成果,获得 ICLR 杰出论文奖,并被 OpenAI、苹果、Stability.ai 等国外前沿机构采用,应用于 DALL・E2、Stable Diffusion 等明星项目中。

自2023年成立以来,团队已获得蚂蚁集团、启明创投、BV 百度风投、字节系锦秋基金等多家知名产业机构的认可,完成数亿元融资。据悉,生数科技是目前国内在多模态大模型赛道估值最高 的创业团队 。此次「Vidu」的推出,是生数科技在多模态原生大模型领域的再一次创新和领先。

()

(来源:站长之家)

免责声明:本站文章部分内容为本站原创,另有部分容来源于第三方或整理自互联网,其中转载部分仅供展示,不拥有所有权,不代表本站观点立场,也不构成任何其他建议,对其内容、文字的真实性、完整性、及时性不作任何保证或承诺,请读者仅作参考,并请自行核实相关内容,不承担相关法律责任。如发现本站文章、图片等内容有涉及版权/违法违规或其他不适合的内容, 请及时联系我们进行处理。

宣传片

宣传片

QQ:

QQ: 微信:

微信:

公安网备案:苏ICP备2022030477号-15苏州钰尚网络文化传媒有限公司

公安网备案:苏ICP备2022030477号-15苏州钰尚网络文化传媒有限公司